JAMA总结:人工智能可以从哪些方面改进临床研究

近年来,人工智能(AI)越来越多地被用于改善临床实践,那么,AI在临床研究中的应用潜力如何呢?2023年11月11日,JAMA发表了一篇社论文章[1],基于《JAMA心脏病学》近期发表的一项研究[2],探讨了AI将可以从哪些方面改善临床研究。

链接:https://jamanetwork.com/journals/jama/fullarticle/2811988

临床研究和临床试验迫切需要创新。目前全球对临床试验的支出超过500亿美元,预计到2030年将增长到850亿美元以上。我们需要通过更有效的临床试验更快提供更好的证据,但遗憾的是,大多数临床试验潜在的基本成本变化不大。

高达20 %的临床试验成本涉及从电子病历手动传输数据到数据采集系统,以及对这些数据进行现场监测,这些都是很容易自动化的任务,所以人工智能在临床试验中的应用可能是革命性的,也可能是必要的。

《JAMA心脏病学》的这项研究探索了自然语言处理(NLP)是否可以根据多个医疗中心的病历文本准确识别心力衰竭住院,从而提高临床试验效率。在临床试验中,结局判定的金标准是由临床事件委员会 (CEC) 审查病历,这需要大量的时间和专业知识。研究在单中心开发和测试了一种NLP模型,通过审查医疗记录自动判定心力衰竭结局,结果显示,与临床事件委员会判定的结局存在很高的一致性(一致性为87%,κ统计量为0.69)。研究因而得出结论,NLP可以大规模准确识别临床事件,提高多中心临床试验的效率。

这项研究提示,基于人工智能的事件判定,如果扩大到全球范围内任何治疗领域的试验,可以显著节省成本和时间。然而,在这个规模化过程中,对校准、验证和定期性能评估的要求尚未确定。用人工智能来替代当前的结局判定模式,建立一个评估人工智能方法的框架,以确保研究结果的可信是至关重要的,特别是对于那些旨在获得监管机构批准的研究或具有重大公共卫生影响的临床试验。

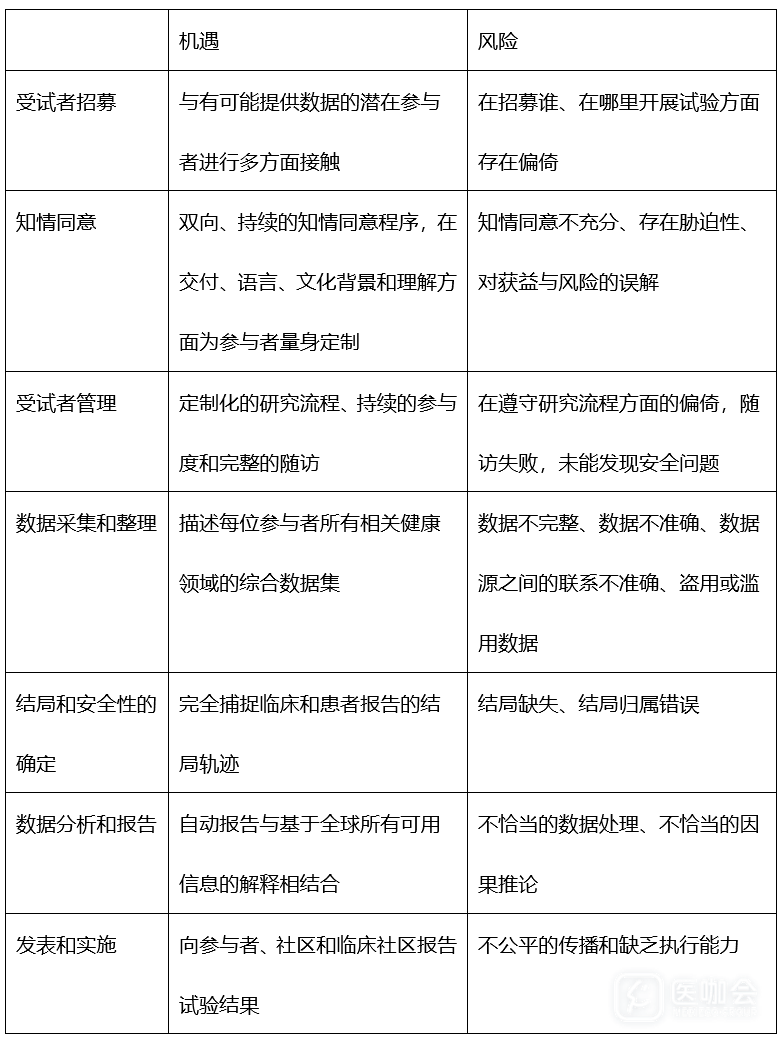

表. 人工智能(AI)在临床试验中的机遇和风险

评估临床试验中人工智能的收益和风险

人工智能潜力巨大,但要确保在临床试验生态系统中安全、有效、合乎伦理地部署人工智能,严格的验证和监管监督必不可少。模型输出不仅需要提供用于评估治疗效益和风险的健康状况的准确评估,而且该框架还必须解决与数据隐私、安全和偏倚有关的风险。从高层次来看,人工智能增强型临床试验监管框架应包括以下领域:

- 信度和效度:哪些人工智能生成的结果需要验证以及应该如何验证和维护?

- 透明度:何时应披露人工智能的使用情况,向谁披露?应如何提交模型供评估?

- 通用性和偏倚:人工智能工具是否能跨越临床、文化和地理环境?人工智能生成的结果是否会通过训练数据或其他过程引入偏倚?

- 隐私:使用人工智能是否保护或侵犯隐私?人工智能是否根据个人同意将数据用于医疗保健或研究?

《JAMA心脏病学》的这项研究结果提醒我们,人工智能增强临床研究的愿景是可行的,如果得以复制,将带来数不胜数的益处。由于这些新技术也蕴含着巨大的风险,包括加剧不平等的风险,必须促进开放科学的发展,增进对人工智能 "黑箱"的了解。在学习过程中,我们必须充分分享缺陷或失败,同时又不破坏研究过程的完整性。

事实上,采用严格的设计和分析方法对人工智能工具进行高质量的评估,并在同行评审的期刊上发表,对于使用人工智能加强临床试验的益处和风险提供高质量的证据至关重要。

参考文献:

1. JAMA. 2023 Nov 11. doi: 10.1001/jama.2023.23822.

2. JAMA Cardiol. 2023 Nov 11. doi:10.1001/jamacardio.2023.4859

-----------分割线---------

邀您参与医咖社区本期话题讨论:你在医院的高光时刻是什么时候?

点击链接:https://new.mediecogroup.com/group/posts/gp_HOPc8hFl/参与讨论,看看其他同行怎么说。