ChatGPT广泛使用,会造成假论文泛滥吗?

Domenico Mastrodicasa是华盛顿大学医学院的一名放射科医生,他在撰写研究论文陷入困境时,会向ChatGPT求助,这个聊天机器人可以在几秒内做出流畅的回复。Mastrodicasa认为“使用ChatGPT可以更快撰写出一篇发表用的论文手稿”。

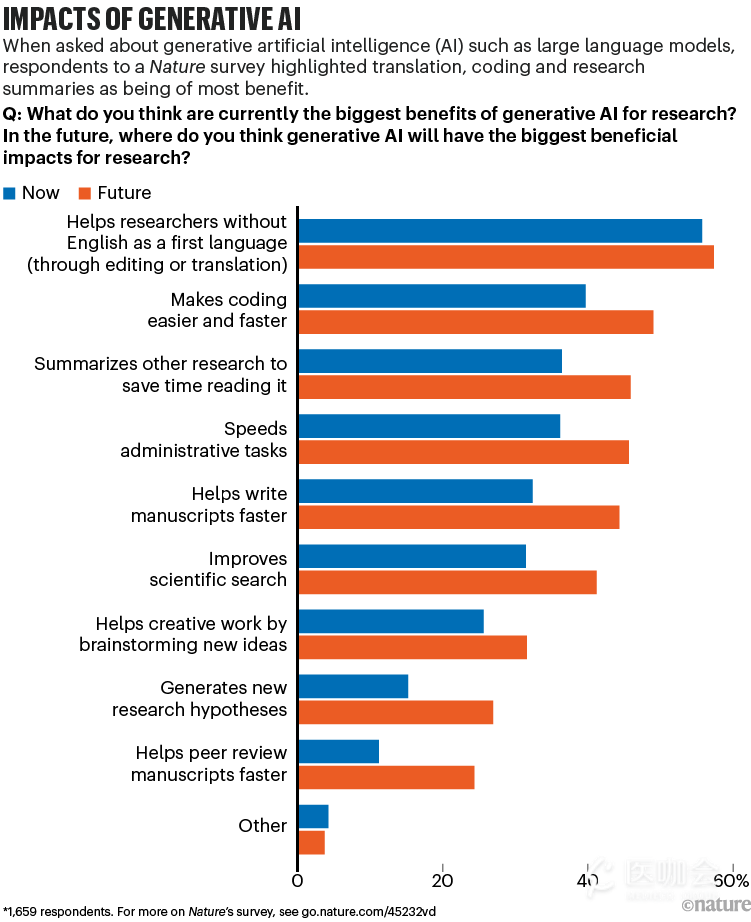

尽管《Nature》的一项调查表明,经常使用ChatGPT的研究者仍占少数,但许多人预计,ChatGPT将成为撰写论文、同行评审和申请基金的常规助手。学术出版商也在学术检索、编辑和快速总结论文工具中试用ChatGPT。许多研究者认为,非英语母语研究者从这些工具中受益最大。一些人表示,可以使用ChatGPT来完成很多工作,这样一来,写论文所花的时间变少了,用于做实验的时间就更多了。

然而,ChatGPT存在信息不准确和虚假的问题。ChatGPT只会生成看起来合理的内容,而不是准确的信息。出版商担心,ChatGPT使用量的增加可能会产生更多劣质或错误的手稿,可能产生大量假论文。

ChatGPT广泛使用,会造成假论文泛滥?

出版商和一些机构对ChatGPT的应用表示了担忧。伦敦研究分析公司Digital Science的首席执行官说:“ChatGPT的广泛使用可能产生低质量的论文,甚至损害科研诚信,出版商感到害怕也是正常的。”

一些研究者已经承认使用过ChatGPT来帮助撰写论文,但未进行披露。他们被发现是由于忘记删除一些明显的使用迹象,例如虚假引用文献或存在明显的ChatGPT回复痕迹(例如自称为AI语言模型)。

理想情况下,出版商应能够检测出ChatGPT生成的文本。但事实是,检测工具无法准确识别出AI生成文本,也可能将人类撰写的内容错认为是AI生成的。

为了解决上述问题,一些出版商完全禁止使用ChatGPT(如Science),而一些出版商表示可以使用ChatGPT,但必须做出声明(如Nature)。一项对100家出版商和期刊进行的研究发现,截至2023年5月,17%的出版商和70%的期刊已经发布了ChatGPT使用指南(各指南不尽相同)[1]。

许多编辑担心ChatGPT的使用更容易产出假文章。《Science》的一位发言人称,ChatGPT可能会加剧论文工厂的问题。

为了应对这一问题,一些期刊采取验证作者真实性的方法。例如,德国的EMBO Press出版社要求作者必须使用机构电子邮件进行投稿,编辑通过视频通话确认作者和审稿人。出版社负责人说:“研究机构和资助者也需要更密切地监控研究者的产出,这不是可以完全委托给期刊的事情。”

ChatGPT使学术发表更公平还是更不公平?

《Nature》在研究者中调查使用ChatGPT对科学研究的最大好处,得到最多的回答是,能帮助非英语母语的研究者[2]。澳大利亚的研究者Tatsuya Amano认为“使用AI工具可以提升科学的公平性”。Amano及其同事进行了一项研究,调查了900多名环境科学家。结果显示,与母语为英语的人相比,非英语母语人士的论文被拒稿率高两倍多,而且后者写文章的时间也更长[3]。Amano表示,ChatGPT可以对非英语母语人士提供“很大的帮助”。

图. 生成式AI对科研的最大益处[2]

Amano的母语是日语,他一直在测试ChatGPT,表示这个过程类似于与母语为英语的同事合作。在《Science》禁止使用ChatGPT之后,他在三月份与人合著了一篇社论,认为只要作者披露其用途,例如将原始手稿与AI编辑的版本一起提交,就可以使学术发表更加公平[4]。

AI伦理学家Chhavi Chauhan则认为:“ChatGPT可能会加剧不平等。”如果出版商使用AI检测工具,则有可能错误地将非英语母语人士编写的文本标记为AI生成。2023年7月,一项研究发现,当前的ChatGPT检测器确实会发生这种情况[5]。

对同行评审的挑战

对审稿人来说,ChatGPT也能提供很大帮助。自从使用ChatGPT Plus作为助手以来,研究者Mastrodicasa表示,可以接受更多的审稿请求了。“通过使用ChatGPT来润色审稿意见,我可以在几个小时内完成审稿”。

而另一位研究者发现,ChatGPT Plus可以方便地为其正在查看的预印本文章创建快速摘要。预印本已经在线发布,因此保密性不是问题。

审稿人可以直接要求ChatGPT进行审稿。但问题是,除了语言修改建议,ChatGPT在其他方面的审稿意见几乎没有价值。在同行评审过程中,对ChatGPT的早期担忧大多与保密性有关。

包括Elsevier、Taylor & Francis和IOP Publishing在内的几家出版商禁止审稿人将手稿和文本上传到ChatGPT以生成同行评审报告,因为他们担心输入的内容可能会被反馈到ChatGPT的训练数据集中,这将违反保密条款。2023年6月,美国国立卫生研究院禁止在同行评审过程中使用ChatGPT和其他生成式AI工具。

道德问题

一些研究者认为,ChatGPT在道德上过于模糊,无法纳入学术发表流程。荷兰一位科学家说:“一个主要担忧在于ChatGPT的工作方式:抓取网页,不考虑偏倚、内容或版权”。

一些新闻机构已经开始阻止ChatGPT等机器人抓取自己的网站,而科学出版商还没有。Wiley表示“正在密切关注有关ChatGPT的行业报告和诉讼”。Wiley呼吁加强监管,包括ChatGPT开发的透明度和审计。

学术出版的变革

加拿大资深机器学习科学家Patrick Mineault说:“从更广泛的角度来看,ChatGPT有可能改变研究的发表和传播方式”。这意味着研究将以机器(而不是人类)可以轻松阅读的方式发表,“将会有新的出版形式”。

在ChatGPT时代,Eisen描绘了一个未来,在这个未来里,研究结果以交互式的“按需论文”格式发表,而不是静态的、一刀切的作品。用户可以使用ChatGPT询问有关实验、数据和分析方法的问题,这将使他们能够专注研究内容。

Mineault补充说,ChatGPT可以改变研究人员进行Meta分析和综述的方式(前提是充分解决这些工具选取信息和参考文献的偏倚问题)。Mineault见过的人类撰写综述,最多包括了大约1600篇参考文献,与生成式AI合作估计可以对更多文献进行总结。“但问题是,当前学术文献中有多少东西可以被利用?”

参考文献:

1. https://arxiv.org/abs/2307.11918

2. Nature.2023;621(7980):672-675.

3. PLoS Biol.2023;21(7):e3002184.

4. Science.2023;379(6636):991.

5. Patterns (N Y).2023;4(7):100779.

文章整理自:Nature.2023;622(7982):234-236.

医咖会员已正式上线,点击链接https://new.mediecogroup.com/user/vip/categories/,查看会员12项权益!