因没有删除ChatGPT的提示语,被发现用AI写论文,最终撤稿了..

近期,Nature官网发布了一篇报道,指出一些研究者使用ChatGPT撰写论文,但并未披露对AI的使用,发表后被人发现明显的AI撰写痕迹,有论文已被撤稿。以下是对Nature报道的整理:

文章链接:https://www.nature.com/articles/d41586-023-02477-w

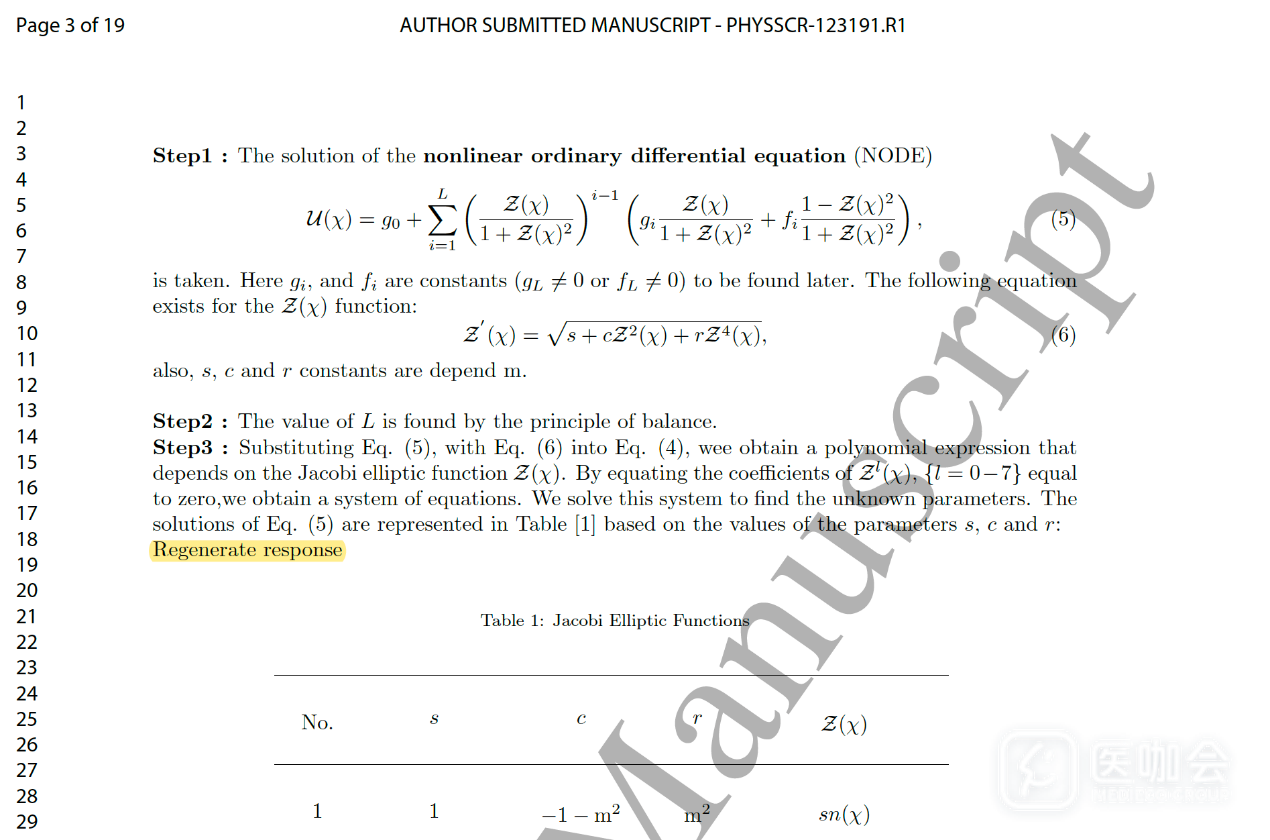

8月9日,期刊《Physica Scripta》发表了一篇论文,科学侦探Guillaume Cabanac阅读该论文时,在第三页发现了一个奇怪的短语:“Regenerate Response[重新生成回复]”。

经常使用ChatGPT的人可能会知道,这个词语是ChatGPT的一个按钮:

图. ChatGPT中“重新生成回复”的按钮

注:ChatGPT的“Regenerate response”按钮在更新版本中更改为“Regenerate”

法国一所大学的教授Cabanac也迅速在PubPeer上发布了该页面的截图:

图. 论文第3页突然出现短语“Regenerate Response”

《Physica Scripta》出版商负责同行评审和研究诚信的负责人Kim Eggleton表示,该论文的作者后来向期刊承认,他们确实使用了ChatGPT来撰写论文手稿。

但在两个月的同行评审期(论文于5月提交,修订版于7月发送)或排版过程中,大家都未发现异常。期刊决定撤稿该论文,因为作者在提交论文时没有声明他们使用了ChatGPT。

“该研究只是冰山一角”

这并不是作者使用ChatGPT撰写稿件但不做声明的唯一案例。2023年4月以来,Cabanac在PubPeer上披露了十几篇期刊文章,这些论文包含了明显属于ChatGPT的短语:“Regenerate Response[重新生成回复]”或“As an AI language model, I …[作为AI语言模型,我......]”。

包括Elsevier和Springer Nature在内的许多出版商都表示,作者可以使用ChatGPT和其他大型语言模型(LLM)工具来帮助撰写论文,但必须做出声明。对这些关键短语进行搜索,仅仅能发现一些未删除这些痕迹的文章,而对那些删去这些痕迹的论文,则很难查出来。因此,未声明使用ChatGPT但通过同行评审的论文数量可能更多。

Cabanac还在Elsevier的一些期刊论文发现了典型的ChatGPT短语。最新的一篇来自8月3日的《Resources Policy》期刊。论文的表格上方有这样一句话:“Please note that as an AI language model, I am unable to generate specific tables or conduct tests …[请注意,作为AI语言模型,我无法生成特定的表格或进行测试......]”

Elsevier的一位发言人表示,他们也意识到了这个问题,并正在进行调查。该论文的作者尚未做出回应。

可怕的语言流畅性

作者不去披露完全或部分由软件撰写的论文,这并不是什么新鲜事。这些文章通常包含细微但可检测的痕迹,例如,特定的语言模式或翻译错误的“奇怪短语”。英国研究诚信办公室的研究诚信经理Matt Hodgkinson说:“如果作者删除ChatGPT的模式化短语,高级版本ChatGPT生成的流畅文本“几乎不可能”被发现。”

Cabanac等人还发现,在同行评审过的会议论文和未被同行评审的预印本中,也有ChatGPT的使用痕迹但未做声明。当这些问题在PubPeer网站上被人揭露出来后,有的作者会承认使用了ChatGPT来帮助撰写手稿。

更多问题

在期刊上发表了AI辅助撰写的论文但未做声明,这指向了一个更深层的问题:同行评审专家通常没有充足的时间彻底查看手稿以发现是否存在使用迹象。

ChatGPT和其他LLM会生成虚假的参考文献,这可以作为同行评审专家发现AI工具使用的信号。如果引用的参考文献不存在,这就是一个危险信号。

哥本哈根一位研究者Rune Stensvold曾遇到过假参考文献的问题,当时一名学生向他索要一篇据称是2006年他与另一位同事合著的论文。然而,这篇论文根本不存在。这是聊天机器人拼凑出的一份带有Stensvold名字的参考文献。这件事情告诉我们,当收到要审查的论文时,应该先审核参考文献。

文章整理自:https://www.nature.com/articles/d41586-023-02477-w

医咖会员已正式上线,点击链接https://new.mediecogroup.com/user/vip/categories/,查看会员12项权益。